04.07.25: 智能与规模的分岔

在规模和智能的选择题里,很可能最终是两个都要,而规模更是必然,而智能则可能受到技术、资本和运气的影响,更可能是偶然。

2025 年 Q1 的变化很多。

春节前 Deepseek 出圈,对 AI 行业甚至中美博弈都有重新平衡的意味。而后,各家模型厂商开始你追我干的升级,OpenAI 的 o 系列、Claude 3.7 Sonnet、Gemini 2.0 系列 以及 Grok 3。同时,各家的 DeepResearch、AI Coding 以及 Manus 开启了 Agent 应用的竞争序列。在这个季度即将结束之前,OpenAI 在 ChatGPT-4o 上推出了更加强大的多模态能力,以“吉卜力滤镜”之名彻底出圈。

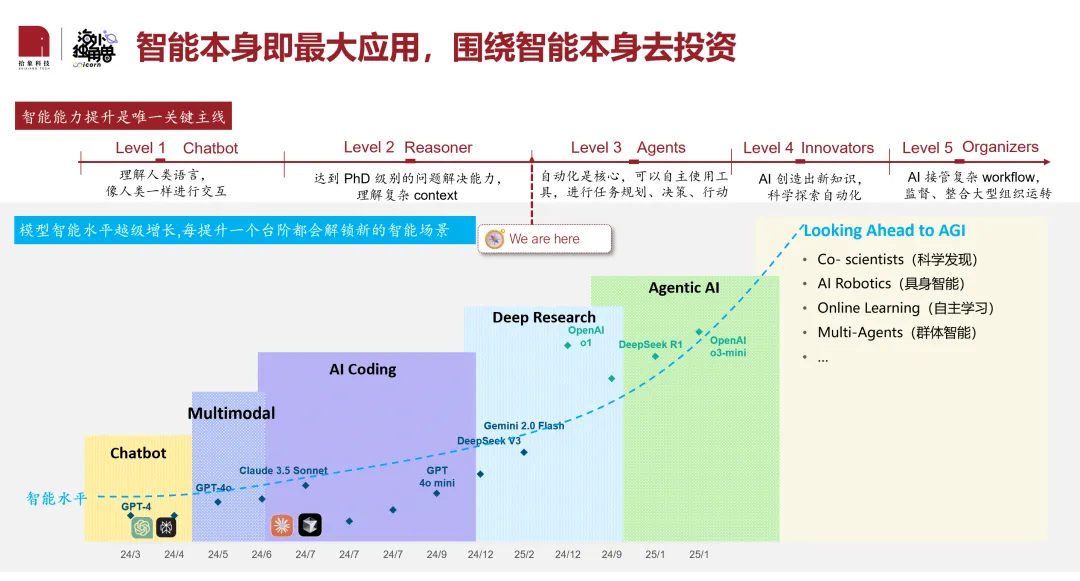

张小珺和 Guangmi 的大模型季报(文字版)中有一张图,很好的概括了这集访谈的核心观点:

Guangmi 说自己是 AI 的“原教旨主义”者,“对两年内实现 AGI 有前所未有的信心,这是 100% 的概率”。在上图的标题中,“智能本身即最大的应用,围绕智能本身去做投资”,就是在投资理念上的投射。他也说自己在为 AGI 布道,的确,这些年他分享的很多信息和观点让很多人都受益匪浅。

这代表了一派观点。有一派,就有另一派。有分歧,很可能两派观点都有可取之处,我想在这篇文章中整理下我的观点,无所谓谁对谁错。

我是从 ChatGPT 出现之后才开始关注到 LLM 和 Gen AI 的,不算前沿。在互联网十几年的工作经验,不可避免的有思维惯性。其中之一,就是认为需求不能从供给中创造出来,技术本身不能成为应用。那套从用户需求出发,沿着“产品 - 增长 - 运营 - 变现”的古典路线仍然成立。但是,事情需要在正确的时间阶段来做,如果技术本身还未成熟,以此为基础做出来的产品自然可能面临颠覆。

这篇文章里,我想结合过去几个月中的几篇文章,围绕一些关键事件,整理一下我的阶段性观点,也算是一篇“季报”。

人类需要更多算力吗?

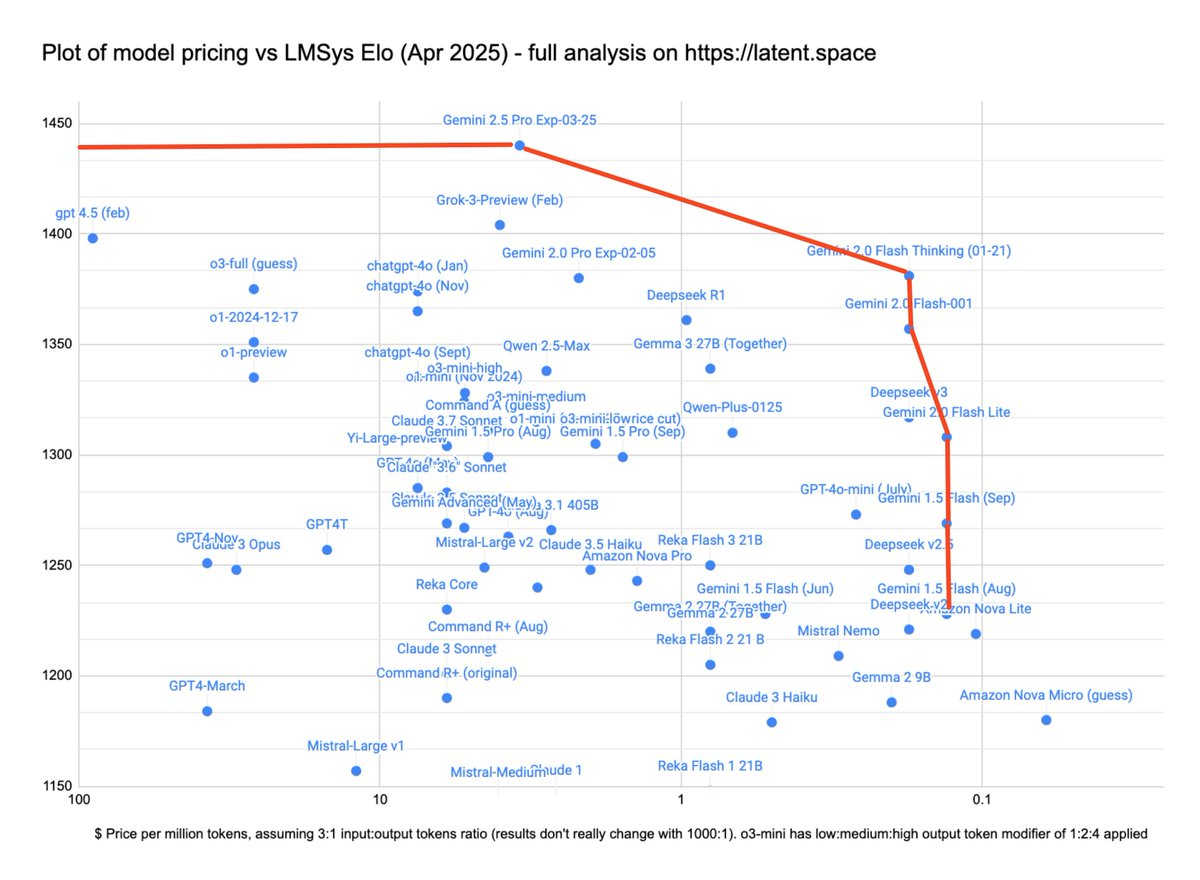

今年第一个关键节点是 Deepseek R1 的出现。今天来看,R1 已经不再是一个 SOTA 模型了,但它的历史意义是肯定超过很多过去和未来的 SOTA 模型的。其中,最重要的是它通过工程效率的改善——或者也有一些“后发优势”——大幅降低了在达到一定智能水平的 token 成本,或者说是推动了模型的帕累托前沿曲线。

一时间,很多人开始怀疑算力需求是不是会崩塌,最流行的辩护是“杰文斯悖论”。我可能是中文互联网上最早用这个“悖论”来做阐释的人之一,但我并不认为成本下降所带来的需求爆发最终都会体现在 Nvidia 的业绩上上涨。相反,需求爆发后,增量的部分反而给低端颠覆者带来了机会,性价比的实现方案会更快的扩散,拿到更多的增量份额。

Gemini 2.0 Flash 以高性价比让它吃到了一波红利,聚合了多家模型接口的开发者平台 OpenRouter 上的流量暴涨,证实了这一观点。Gemini 2.0 系列模型的训练和推理背后是 Google 的第六代 TPU 芯片 Trillium 支持,在成本效益上具有独特的优势。

同样具有成本优势的 Deepseek 在国内获得了更广泛的支持,包括腾讯、阿里在内的大厂纷纷接入 Deepseek 模型,趁 Deepseek 自己算力不足的时机来“接”这一波流量。在低成本和够用的性能体验之下,Deepseek 开始在挤地铁的打工人的手机上出现。看到这些情况出现的时候,我意识到,需求即将觉醒,因为海量用户一定会萌生出 AI 研究者们想象不到的需求。

时间点快进到 3 月份,Manus 出现了。它基于 Claude 3.x Sonnet 模型强大的 Tool Use 能力构建,据说一个任务成本要 2 美元。也就是说,一个任务就要消耗百万 token。这数字并不令人惊讶:因为如果你去用一些 Coding Agent 或 Deep Research 类的 Agent 产品,都能理解,每一个任务背后惊人的 token 消耗量。我自己使用 Windsurf 的体验是:每一条我发出的任务指令,会触发连锁式的 6 条 Agent 任务指令。随着链条的延长,发给模型的上下文也会变长,这里的乘数效应显然是多阶的。

这就让算力需求朝向另一个方向演化:Agent 会消耗掉几何级数级别的 token 数量,而作为 Coding 和 Tool Use 能力最强的模型,Claude Sonnet 保持了高定价。

这是什么情况呢?模型竞争走向了两个极端:要么走物美价廉的性价比路线,最终靠规模取胜,要么在关键领域保持 SOTA 地位,以性能领先来保持定价权。

| 模型策略 | 代表厂商 | 核心优势 | 市场定位 |

|---|---|---|---|

| 规模优先 | Deepseek, Gemini 2.0 | 低成本、规模效应 | 大众市场 |

| 智能优先 | Claude, GPT-4 | 能力领先、定价权 | 高端市场 |

而竞争是动态的,SOTA 轮流坐,结果是高端能力不断被下放。Coding 和 Tool Use 能力之所以重要,是因为它们可以把模型智能延展为行动的能力。Deepseek 最新版本的 V3 大幅提升了这两项能力,而 Google 的 Gemini 2.5 Pro 则是新一代 Coding 能力的 SOTA 模型。

我相信人类需要更多的算力,但这种需求的释放仍然来自于低廉的成本和多样的应用生态,最终渗透到普罗大众的生活中去。这样来看,Manus 和很多今天令人眼花缭乱的 Agent 应用都是超前的,它们需要在模型的帕累托前沿曲线找到其它的可行性点,跟随需求扩散进入广泛的市场。

人类需要极致个性化吗?

Kyle Chayka 在他去年出版的书《Filterworld》中描述了一个现象:算法推荐正在创造一种全球性的审美趋同。从 Airbnb 的“千禧粉”公寓,到 Instagram 上的“咖啡美学”,再到抖音上的“clean girl”妆容,看似个性化的推荐,最终导向了某种程度的同质化。这个观察让我在《吉卜力之 Vibe》一文中提出了这样的一个问题:极致的个性化是否真的是必要的?

这是一个需求侧的“元问题”。我思考的出发点是:人性是所有需求的起源,生物性让我们产生物质需求,而社会性让我们产生精神需求。

互联网诞生以来,似乎一切都在走向个性化——也就是每个人各取所需——的方向。数据和算法在其中起到了关键的匹配作用,但供给侧的瓶颈很快就出现了。这时候 Gen AI 出现了,理论上可以提供极致个性化的供给——Agent 就是一种按需定制的实现,如果它能低成本、大规模的产品化,它就有机会成为新一代的平台。

举例来说,你有一个需求,在过去,你去 Google / Amazon 上搜索选项,通过反复比较找到一个最接近、但不完美的解决方案——很多人会和你使用相同的解决方案;而在 AGI 的假设下,Agent 或者某个机器人,会帮你精确的实现这个想法,完全按照你的定义,这是极致的 For You。

我对“极致个性化”作为一种广泛需求持保守看法。其中的一个底层原因正是人性中的社会性:人类还是希望找到和一群人的共性。这也是为什么人类会超出血缘关系而自然的产生各种社群和组织,也会愿意和其他人分享和交易。极致个性化,也就是完全给每个人提供不一样的供给,这种社会性的价值就消失了。比如,每个人都在讨论同一部“哪吒”电影,尽管信息流已经高度算法化,但你会发现它仍然是一个社交场所,每个人看到的内容并不是完全不同。如果我们每个人看到的“哪吒”是不同的——哪怕只是增加了一些不同的分支情节,都可能让这种社交讨论崩溃。

Vibe 这个词其实描述的就是这种小范围、小规模的社会性。ChatGPT-4o 用“吉卜力滤镜”的角度赢得的快速用户增长,背后是模型能力的进化,但实际上它利用了社交传播中的一些规律,为用户提供了可以模仿、易于传播的“滤镜”和“模板”。就像 Chayka 观察到的那样,某种程度的审美趋同不是算法的失败,而是人性的驱动。我在之前的文章中,把它和 Instagram 及抖音的早期成长相比,这些路数其实很“古典”。

需求分析中,这种来自人性底层的需求是极为刚性的,可以认为是不变的东西,是在纷繁复杂的技术动态中少数可以抓住的东西。并不是因为有了新的技术,理论上可以追求极致个性化,就一定要给每个人提供不一样的东西。这就是为什么很多 AI 产品局限在 prosumers 这个“早期采纳者”的群体里,还是因为对人性中的“刚需”把握不足,产品表达上还在初级状态。

为什么要谈这个问题呢?我认为,它和我在 3 月份接连写的关于 AI 对组织的影响有关(见《被 AI 折叠的组织》和《AI 原生公司》)。对于 AGI 降临的一个担忧在于:大量的人类将失去工作。这种替代效应在 Agent 产品开始大量出现之后似乎更加明显了。但是,这些产品旨在提供的,刚好是我所说的“极致个性化”类的供给,比如,Deep Research 可以替代初级的研究员,但这类需求的分布是相对密集的,主要在特定行业存在,对于普通人而言,制定复杂的旅游攻略、医疗建议等需求相对低频,而且,也不需要极致个性化。

而真正广泛的需求其实是基于 vibe 的社会化需求:人们会因为看到其他人的需求而产生自己的需求,也就是说需求会刺激需求。而要满足这些需求,仍然有机会在小范围内,基于细分市场,实现一定的规模经济。这个规模很可能是 AI 与人类协作共生、发挥更大作用的“甜蜜点”:大量的重复性工作可以由 AI 高性价比的完成,而关键决策则在 AI 的辅助下,由人类来完成。

关税与 AGI

世界是复杂的,特别是在 2025 年 4 月 2 日之后。

人们对“对等关税”还没有形成共识,非共识意味着持续的震荡。在不确定性中,一件事是确定的:一些信心会消失。

避险心态可能会影响对 AGI 理想的激进追求。在 Q1 看到的情况是:基础模型没有出现大的能力跃迁,但小的改进,包括在工程效率、特定能力象限上的提升,是层出不穷的。

而目前来看,唯一能加速实现 AGI 的变量是基础模型大幅度的能力跃迁。看起来,各家似乎都在酝酿大招,但不确定性仍然很高,一些基本问题在过去几年中始终得不到解决,很多改进手段更像是打补丁:其作用更多在于提高下限,而不是提高上限。

如果智能的上限没有打开,当你使用它进行长链条的思考、推理或任务执行时,就会叠加和放大错误,最终导致任务失败。我们很可能会在这种胶着的状态中卡住一段时间——这和惯常叙事不同,但历史的大部分时间都如此平淡无聊。

乐观的看,人类对智能的掌控还是迈上了一个台阶:现在的模型切实提高了知识工作的生产力——即便还做不到彻底替代和解放人类,这种效率提升也非常有价值。在这个台阶上,很多打补丁的工作,比如如何管理幻觉带来的错误和风险,如何把知识产权、收益模式等问题想清楚、谈清楚,都很有意义,能为下一个阶段做好准备。

规模的坦白局

Sam Altman 非常直白的讲,OpenAI 会选择 10 亿用户,而不是 SOTA 模型。

这句话让我心生认同。可能是一代人有一代人的局限,(惭愧的)作为一个同龄人,在东看西看了半天之后,我还是觉得规模是 AI 的终局,而 SOTA 是走向这个终局的手段,而且只是手段之一。

我在一个访谈中提到,移动互联网的的那一套打法在 AI 时代是否还适用。我的观点很简单:AI 还没有走到那个阶段。现在的状态是:基础模型确实还有空间,但有多大的空间,见仁见智;而由于基础模型本身仍在变化,产品形态和生态结构还不稳定。所以就会出现模型一迭代,应用就死一片的情况。

你还记得吗:iOS 每次升级,都会有很多应用死掉。唯一区别是 iOS 是每年升级一次而已,而大模型可能是每周都在升级。在这样的情况下,在投放、增长和运营等问题上感到纠结和迟疑,也很正常,这个仗不是不打,而是还没到时候。

除此之外,一切都在走向熟悉的范式:成本下降,体验出圈,规模变大。之前一个辩论的点是:大用户量带来的数据没法提升模型能力。这可能是对的,但它仍然有点“拿着锤子找钉子”,即便数据飞轮不转,规模也可能在成本摊薄、网络效应和品牌资产上带来压倒性的竞争优势。

在规模和智能的选择题里,很可能最终是两个都要,而规模更是必然,而智能则可能受到技术、资本和运气的影响,更可能是偶然。

This time it's different 这句话在前半段总是对的。太阳底下无新鲜事,要到最后才对。

Links + Notes

本周的 Links + Notes 分享 6 篇文章,从宏观产业,到技术文化,再到人格塑造。我把这些文章看作是隐藏在互联网各个角落的线索,虽然看起来零散,但终有连点成线的时刻。

- 资本、AGI 与人类雄心:L Rudolf L 探讨了 AGI 的到来可能通过资本对劳动力的全面替代,固化现有权力结构,最终扼杀人类的雄心壮志。

- 放弃工业化:你没买到的最贵东西:Conrad Bastable 剖析了西方国家,特别是欧洲,如何通过优先考虑环境法规而非培育本土制造业,损害了自身工业基础,并可能在未来的技术竞争中失去主导权。

- arXiv 内部揭秘:讲述了这个改变现代科学面貌的在线研究资料库如何从一个简单的高能物理论文分享平台,发展成为科学交流的基础设施,特别是在人工智能等快速发展的领域。

- 模型上下文协议(MCP)的创造者:Latent Space 访谈了 Anthropic 两位 MCP 的创造者,介绍了这个旨在解决 AI 应用与工具生态系统集成复杂性的新协议,它试图成为“AI 应用的 USB-C 端口”,为未来 AI 应用的互操作性提供标准化解决方案。

- 你用什么软件就是什么样的人:作者 Omer 发现,软件选择如何从单纯的功能性考虑演变为个人身份和生活方式的表达,就像选择特定品牌的服装一样,成为了一种身份认同的象征。

- 超级马拉松心态:超级马拉松选手 Courtney Dauwalter 如何在极端压力下保持前进,为我们提供了应对长期挑战的实用策略。

Capital, AGI, and human ambition

L Rudolf L 是一位活跃于 LessWrong、Effective Altruism Forum 和 Substack 等平台的思想领袖,专注于人工智能对社会的影响、理性思维及技术哲学等领域的讨论与研究。在他的文章《资本、AGI 与人类雄心》(Capital, AGI, and human ambition) 中,提出了一个发人深省甚至略带寒意的观点:AGI 的到来可能固化现有权力结构,最终扼杀人类的雄心壮志。

文章开篇就点明了这场变革的核心机制:

人工智能的关键经济效应在于,它使资本越来越成为劳动力的通用替代品。雇佣人类付出时间来完成工作的需求减少了,因为你可以用资本来取代——例如,运行软件的数据中心取代了人类的脑力劳动。

The key economic effect of AI is that it makes capital a more and more general substitute for labour. There's less need to pay humans for their time to perform work, because you can replace that with capital (e.g. data centres running software replaces a human doing mental labour).

L Rudolf L 指出,这不仅仅是效率提升,而是生产要素之间关系的根本性重塑。过去,资本需要与劳动力结合才能创造价值;未来,资本本身(以 AI 和算力的形式)或许就能独立完成大部分价值创造过程。这种转变的潜在后果是令人不安的:

总的来说,这指向了变革性人工智能一个被忽视的负面影响:社会可能变得永久静态,当前的权力不平衡可能被放大,然后变得不可改变。

Overall, this points to a neglected downside of transformative AI: that society might become permanently static, and that current power imbalances might be amplified and then turned immutable.

这里触及了一个令人担忧的问题:技术进步非但没有带来更大的流动性,反而可能成为终极的“固化剂”。想象一个世界,在 AGI 到来的那一刻,谁拥有资本,谁就可能永远锁定了优势地位。这种前景让作者深感不安,他并非仅仅担忧经济分配,更在意人类精神层面的影响:

在这些情景中,最让我动容的是,一个拥有固化统治阶层的静态社会,在我看来毫无活力和生机。如果可以,我们不应扼杀人类的雄心。

What most emotionally moves me about these scenarios is that a static society with a locked-in ruling caste does not seem dynamic or alive to me. We should not kill human ambition, if we can help it.

L Rudolf L 进一步阐释了资本如何在这种新范式下获得压倒性优势,特别是在“人才”这个关键要素上:

但真正的区别在于 AI 可以被克隆。目前,巨额资金追逐着某个取得突破的明星研究员……但作为 AI 的明星研究员可以被轻易克隆。任何人——或者至少,任何有足够资金购买 GPU 的人——都能拥有这位 AI 明星研究员。

But the real difference is that the AIs can be cloned. Currently, huge pools of money chase after a single star researcher who's made a breakthrough... But the star researcher that is an AI can just be cloned. Everyone—or at least, everyone with enough money to burn on GPUs—gets the AI star researcher.

这描绘了一个“赢家通吃”加剧的未来,但“赢家”的定义从拥有独特人类才华的个体,转向了拥有足够资本部署 AI 的实体。曾经依赖“伯乐”发掘“千里马”的模式,可能被资本直接“复制”顶尖能力所取代。这种权力向资本的集中,甚至可能动摇现代社会运行的基础逻辑。作者引用了亚当·斯密的经典论述来对比:

亚当·斯密可以写道,他的晚餐并非来自屠夫、酿酒师或面包师的仁慈……今天的古典自由主义者可以有理有据地声称,历史的弧线确实倾向于所有人的自由和富足,这不是出于国家的仁慈,而是源于资本主义和地缘政治的激励机制。但在劳动力替代型 AI 之后,这将不再成立……如果历史的弧线继续倾向于自由和富足,那将只能是出于国家(或 AI 巨头)的仁慈。

Adam Smith could write that his dinner doesn't depend on the benevolence of the butcher or the brewer or the baker... The classical liberal today can credibly claim that the arc of history really does bend towards freedom and plenty for all, not out of the benevolence of the state, but because of the incentives of capitalism and geopolitics. But after labour-replacing AI, this will no longer be true... If the arc of history keeps bending towards freedom and plenty, it will do so only out of the benevolence of the state (or the AI plutocrats).

这是一个警示:我们习以为常的、基于相互依赖和激励机制的社会进步逻辑,在 AGI 时代可能失效。如果人类劳动力不再是经济增长的关键要素,那么保障人类福祉的驱动力,可能就从“必要性”转变为“选择性”的“仁慈”——而这种仁慈是否可靠,历史并没有给出乐观的答案。这对那些试图通过才华和努力实现阶层跃迁的“异类成功者”(outlier human success)意味着什么?

So on net, sufficiently strong labour-replacing AI will be on-net bad for the chances of every type of outlier human success, with perhaps the weakest effects in politics. This is despite the very real boost that current AI has on entrepreneurship.

因此,总的来看,足够强大的劳动力替代型 AI 将对几乎所有类型的异类人类成功机会产生净负面影响,可能在政治领域影响最弱。尽管当前的 AI 确实对创业活动有显著推动作用。

即使 AI 短期内降低了创业门槛,长期看,如果顶尖的认知能力可以被资本无限复制,那么人类个体通过独特才智脱颖而出的空间可能会被极大压缩。文章的结尾,作者发出呼吁:

之前的剧变——数次工业化浪潮、互联网等等——都极大地激发了人类的雄心。面对 AI,我们可能迎来了人类雄心最后也是最伟大的机遇——紧随其后的,可能是它永远的消亡。你的反应怎能不是:“活在当下,抓住时机”?

Previous upheavals—the various waves of industrialisation, the internet, etc.—were great for human ambition. With AI, we could have the last and greatest opportunity for human ambition—followed shortly by its extinction for all time. How can your reaction not be: “carpe diem”?

L Rudolf L 的这篇文章,并非预测一个必然黯淡的未来,而是揭示了一种需要我们正视的潜在风险。我们需要思考:在一个 AI 日益强大的世界里,我们如何设计机制来保护和激发人类的能动性与创造力?